Compañías tecnológica e instituciones como la RAE se disputan a los licenciados en letras con conocimientos computacionales. Su objetivo es lograr que las máquinas hablen mejor y entiendan la ambigüedad del lenguaje natural. «Nos pagan como a los programadores», cuentan

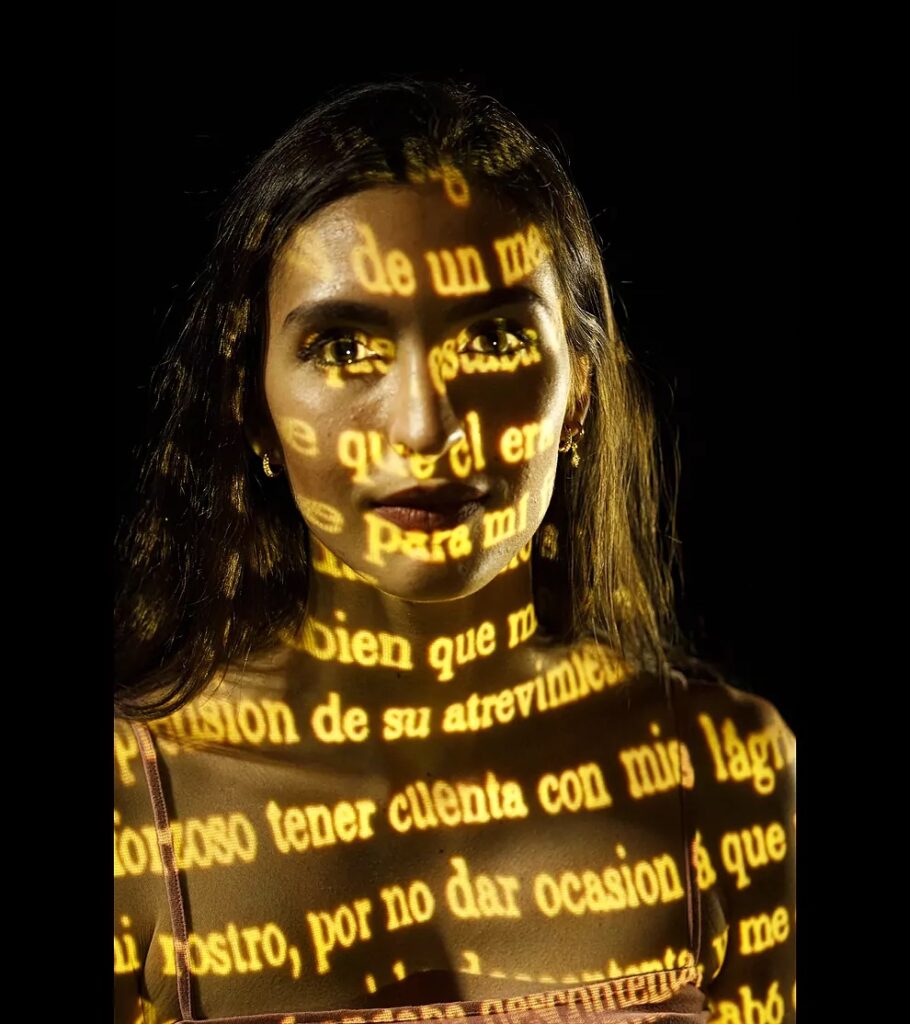

LUIS ALEMANY / Madrid / CARLOS GARCÍA POZO / Fotografías / PAPEL / EL MUNDO

La Inteligencia Artificial puede hacer cosas inconcebibles para la mayoría de los humanos. Es capaz de curar un cáncer. Un robot puede internarse en el cuerpo del paciente, puede localizar el tumor en cada ramificación, puede conocerlo a través de métricas previas, puede cruzar esos datos con el historial médico del enfermo, puede proponer un tratamiento y puede ejecutarlo.

En cambio, la Inteligencia Artificial aún fracasa en tareas que a los humanos nos parecen tan naturales como escuchar la frase «me duele» y hacernos una idea de lo que quiere decir su emisor. ¿Duele con desesperación o con fastidio? «Me duele mucho». ¿Cómo duele? «Me duele como si tuviese burbujas chocando». ¿Dónde le duele? «Por aquí, como por detrás»… No es fácil que la Inteligencia Artificial, en este momento del desarrollo tecnológico, se aclare en la vaguedad del lenguaje oral.

El ejemplo del robot cirujano explica el boom de la investigación lingüística de la Inteligencia Artificial. Este año, el Gobierno presentó el PERTE Nueva Economía de la Lengua, un programa de inversión de 1.100 millones de euros. Y hace unas semanas, la Real Academia Española reunió en Santander a representantes de Telefónica, Meta, Microsoft y Google, entre otros investigadores académicos y responsables de proyectos públicos, en un curso de la Universidad Internacional Menéndez Pelayo sobre el aprendizaje del lenguaje natural para las máquinas.

La conclusión de aquellas jornadas fue sorprendente: el gran reto en la investigación tecnológica consiste, en este momento, en aprobar lengua. En conseguir que los robots entiendan y se hagan entender ante los humanos, que puedan procesar un «me duele mucho» y darle una respuesta adecuada. «El 50% de la investigación en Inteligencia Artificial se dedica en este momento al aprendizaje del lenguaje natural», dijo en Santander Alfonso Ureña, presidente de la Sociedad Española para el Procesamiento del Lenguaje Natural y catedrático en Jaén.

La consecuencia de ese reto es que el oficio de lingüista, que tradicionalmente estaba enfocado a la docencia, a la investigación académica y, como mucho, al trabajo editorial, está en la espuma de la ola. Hoy, hay lingüistas trabajando al lado de los ingenieros de telecomunicaciones en proyectos de vanguardia en todo el mundo y no como casos aislados.

«Empezamos el Máster de Letras Digitales hace seis años y el problema con el que nos encontramos en seguida fue que las empresas captaban a los alumnos para las prácticas en diciembre, antes de llegar a la mitad del curso. Así que yo tengo que perseguir a los alumnos para que acaben el máster, para que hagan un buen trabajo de fin de curso. Nuestros alumnos son joyas para las empresas», explicaba en Santander Amelia Sanz, catedrática de la Universidad Complutense y coordinadora de su Máster en Letras Digitales. «Y ellos mismos nos lo dicen: no sabía que un filólogo servía para tantas cosas«.

PARA SABER MÁS

Las ideas. El silencio de los humanistas sobre la inteligencia artificial

- REDACCIÓN: PABLO SANGUINETTI

El silencio de los humanistas sobre la inteligencia artificial

Máquinas tan avanzadas que parecen seres humanos. «Sentía que estaba hablando con una criatura inteligente»

- REDACCIÓN: JOSE MARÍA ROBLES

- REDACCIÓN: ILUSTRACIONES: JOSETXU L. PIÑEIRO Madrid

«Sentía que estaba hablando con una criatura inteligente»

¿Para qué cosas? «Mi trabajo consiste en desarrollar sistemas cognitivos de implantación tecnológica. Estamos hablando de chatbots o de asistentes de voz como Siri o Cortana, pero más específicos, hechos para las necesidades de clientes concretos. También hacemos herramientas de interacción con el aspecto de humanos digitales… Cosas así», explica la lingüista Lidia Garrido. «En los equipos de trabajo nos unimos tres tipos profesionales: los desarrolladores, que son programadores; los responsables de la user experience, que son diseñadores gráficos, arquitectos o perfiles parecidos, y que ajustan el tono para que el mensaje sea amable… Y los lingüistas, que diseñamos los modelos lingüísticos para entrenar el motor de cada inteligencia artificial, nos ocupamos del testeo y de su validación».

En síntesis: los lingüistas computacionales usan los llamados corpus, bancos de datos lingüísticos hechos de textos y grabaciones con conversaciones reales para transformarlos en algoritmos predecibles, de modo que, cuando el teléfono de nuestro banco nos oiga decir «he perdido mi tarjeta», reconozca la frase y sus variaciones entre otras miles con las que ha sido entrenado y sepa cómo procesarla.

«En uno de los equipos en los que trabajo somos tres lingüistas, tres programadores y un arquitecto de software. Y no siento que el papel de los lingüistas sea el de auxiliar, me parece que estamos en el centro de las decisiones y que se nos pide mucho esfuerzo de análisis«, continúa la lingüista Irene Etayo. «Entre otras cosas, porque aportamos la capacidad de ver el trabajo en conjunto y porque tenemos que actualizar constantemente los conocimientos. Cada año mejoran los procesos de entrenamiento. Aunque no nos demos cuenta, el asistente de voz que nos atiende en un teléfono de información ha mejorado mucho en cinco años. El flujo de la conversación es mucho más natural».

Su colega María Ballesteros aporta un caso concreto y fácil de entender: «El año pasado trabajé para la RAE en un proyecto para crear un chatbot dedicado a las dudas sobre puntuación», explica Ballesteros. «El corpus era el conjunto de las dudas que los usuarios habían hecho en Twitter a la RAE sobre comas, puntos y comas, signos de interrogación… Hice una categorización y la hice a mano, porque eso no lo pude hacer ninguna IA, y entrené al motor con esa información… El sistema tiene límites. Si le preguntamos ¿cómo debo escribir ‘hola Juan’?, la Inteligencia Artificial no puede contestar que la coma va entre hola y Juan, pero sí puede entender que le están preguntando por la coma del vocativo y dar una respuesta con las reglas de ese caso».

Y ese trabajo, ¿se paga bien? ¿Mejor que un puesto de profesor de lengua en un colegio privado? «Creo que la enseñanza no se paga muy bien, de modo que es probable que a mí me paguen mejor», responde Lidia Garrido. «Yo estoy al principio de mi carrera. Sé que hay margen para progresar en los sueldos y acabar cobrando como un ingeniero». «Mi empresa nos paga como a los programadores. Y sí, hay un recorrido salarial por delante que no existe en otros oficios», añade Etayo.

Vamos con otro ejemplo concreto como el del robot cirujano: el del taxi autotripulado. Imaginemos que tres amigos salen a cenar en una ciudad que no conocen. Cuando terminan, cogen un taxi. «¿A dónde los llevo?», pregunta el conductor. «A un sitio donde tomar una copa». «Mejor, un sitio donde bailar, ¿no?». «Bueno, beber y bailar». «Pero que la gente no sea muy mayor». «Tampoco muy joven, ¿eh?». «Oye, yo casi me vuelvo al hotel que estoy fatal».

Un taxista humano puede procesar todos esos mensajes contradictorios y dar con un destino apropiado para sus pasajeros. Un robot taxista, en cambio, se sentirá perdido en medio de esa cháchara de bebedores.

«La Inteligencia Artificial funciona muy bien si al taxi le decimos ‘Al aeropuerto’, que es un mensaje sencillo, pero tiene problemas con la ambigüedad de una conversación como esa«, explicaba tras el curso de la RAE en Santander Alberto Pinedo, responsable de investigación de Microsoft en España. «En el caso de Autopilot [la tecnología de los coches autoconducidos] ya hay un progreso, se les está dotando de redes neuronales recurrentes que secuencian lo que les decimos, lo convierten en vectores y hacen una lectura del conjunto. Pero en una conversación en la que aparecen los dobles sentidos y la ironía, el reto es complicado».

Entonces, ¿es previsible que las máquinas aprendan a interpretarnos no literalmente en los próximos años? Richard Benjamins, jefe de investigación en IA de Telefónica y también ponente en el curso de la RAE, explica que la Inteligencia Artificial no ha desarrollado la empatía, pero ya ha aprendido a representarla. «Yo creo que se puede progresar mucho en relativamente poco tiempo, porque es posible añadir sensores en las máquinas que interpreten el lenguaje corporal de los humanos, sus entonaciones, sus medias sonrisas… El problema es que ahí se abre un horizonte de duda moral. ¿Queremos que las máquinas sepan cuál es nuestro estado de ánimo? ¿Que hagan métricas con cada caso? La Unión Europea dice que ése es un ‘riesgo moderado con obligación de transparencia'».

«Por otra parte, y aquí hablo como ciudadano, creo que hay un bien común en que la Inteligencia Artificial hable bien», continúa Pinedo. «Los adolescentes de hoy se comunican con mensajes muy sucintos, te escriben ‘OK Papá’ en su mensaje y nada más porque eso es lo que han aprendido en los textos predictivos. Eso es un empobrecimiento que debemos evitar, igual que debemos evitar las burbujas de lenguaje».

Microsoft, según cuenta Pinedo, lleva trabajando con lingüistas desde que fundó su división de investigación en 1991. «En Telefónica hubo una línea de trabajo muy ambiciosa entre 2000 y 2007 y, después, a partir de 2016. Diría que hoy, un 10% de la gente que trabaja en investigación viene de la lingüística. Hay también psicólogos, algún sociólogo…», explica Benjamins. «Tenemos equipos trabajando en inglés, español, alemán y portugués de Brasil. Y va a haber más trabajo en los próximos años. Lo que nos faltan son corpus de datos, no proyectos ni interés por investigar».

Pinedo, Benjamins, Etayo, Garrido y Ballesteros… Todos coinciden en una idea: el trabajo en equipo entre lingüistas y profesionales STEM es una experiencia gozosa, amplía los marcos intelectuales de todos los implicados y permite muchas soluciones creativas. Tras muchos años en los que se ha debatido el sentido de las humanidades en un mundo basado en el conocimiento científico y técnico, aquí hay una respuesta que va más allá de las buenas intenciones: la lingüística también crea progreso y riqueza.

Fuente: https://www.elmundo.es/papel/lideres/2022/07/21/62d92badfc6c83e0688b459c.html